Amazon Web Services (AWS) ha annunciato cinque nuove soluzioni di intelligenza artificiale generativa che renderanno più facile l’accesso ai foundational model (FM) ad alte prestazioni, indipendentemente dal settore di riferimento.

Le nuove soluzioni permetteranno di sbloccare l’intero potenziale della codifica generativa basata sull’intelligenza artificiale e creare app differenziate, semplificando al tempo stesso lo sviluppo, senza compromettere privacy e sicurezza.

Dalla disponibilità generale di Amazon Bedrock, un nuovo servizio per costruire e scalare applicazioni di AI generativa per la creazione di testo, immagini, audio e dati sintetici in risposta a un prompt, all’arrivo di Embedding Amazon Titan, un modello linguistico di grandi dimensioni (LLM) in grado di aiutare i clienti ad ottenere il massimo della potenza di qualsiasi FM utilizzando i propri dati proprietari, AWS vuole mostrare il proprio impegno nel democratizzare l’accesso all’AI generativa per le aziende di qualunque dimensione e settore.

Amazon Bedrock sarà il primo servizio di intelligenza artificiale generativa completamente gestito a offrire Llama 2, il LLM di nuova generazione di Meta, dando ai clienti la flessibilità e la possibilità di utilizzare i modelli migliori per le loro esigenze specifiche.

Tra le novità, anche nuove funzionalità di intelligenza artificiale generativa per CodeWhisperer e QuickSight, per permettere ai clienti di creare nuove applicazioni di intelligenza artificiale generativa, migliorando la produttività dei dipendenti.

Per i clienti della pubblica amministrazione, invece, AWS ha annunciato di aver ottenuto dall’Agenzia Nazionale per la Cybersecurity (ACN) italiana la qualifica QI2/QC2 per ospitare dati critici e carichi di lavoro della Pubblica Amministrazione italiana. Grazie alla presenza della Regione AWS Europe (Milano) da aprile 2020 e alla nuova qualifica QI2/QC2 ottenuta da AWS, i clienti e partner possono ora sentirsi sicuri di sviluppare servizi cloud innovativi in grado di gestire i carichi di lavoro critici della Pubblica Amministrazione italiana eseguiti sull’infrastruttura cloud AWS. La qualifica ottenuta da AWS sarà disponibile sul Cloud Market Place di ACN nelle prossime settimane.

Con le innovazioni annunciate oggi, AWS intende offrire ai clienti – pubblici e privati – maggiore sicurezza, scelta e prestazioni, aiutandoli ad ottenere il massimo dall’intelligenza artificiale generativa e dalla potenza del cloud.

AWS aiuta a sviluppare applicazioni di AI generativa su scala

AWS aiuta a sviluppare applicazioni di AI generativa su scala

Annunciato ad aprile, Amazon Bedrock è un servizio completamente gestito che rende disponibili i modelli di base (FM) delle principali aziende di AI attraverso un’unica application programming interface (API). I modelli FM sono modelli di machine learning (ML) di grandi dimensioni, pre-addestrati su grandi quantità di dati. La flessibilità dei modelli FM li rende applicabili a un’ampia gamma di casi d’uso, dalla ricerca alla creazione di contenuti alla scoperta di farmaci.

Tuttavia, la maggior parte delle aziende che vogliono adottare l’AI generativa si trova di fronte ad alcuni ostacoli. In primo luogo, hanno bisogno di un modo semplice per trovare e accedere a FM ad alte prestazioni che diano risultati di qualità e siano più adatti ai loro scopi. In secondo luogo, i clienti vogliono che l’integrazione delle applicazioni avvenga senza problemi, senza dover gestire enormi cluster di infrastrutture o sostenere costi elevati. Infine, i clienti vogliono poter utilizzare facilmente il FM di base e creare applicazioni differenziate con i loro dati. Poiché i dati che i clienti vogliono personalizzare sono una proprietà intellettuale incredibilmente preziosa, devono rimanere completamente protetti, sicuri e privati durante questo processo, e i clienti vogliono avere il controllo su come i dati vengono condivisi e utilizzati.

Grazie alle funzionalità complete di Amazon Bedrock, i clienti possono facilmente sperimentare una serie di FM di alto livello e personalizzarli privatamente con i loro dati proprietari. Inoltre, Amazon Bedrock offre funzionalità differenziate, come la creazione di agent gestiti che eseguono attività aziendali complesse, dalla prenotazione di viaggi all’elaborazione di richieste di risarcimento assicurativo, dalla creazione di campagne pubblicitarie alla gestione dell’inventario, senza scrivere alcun codice.

Poiché Amazon Bedrock è serverless, i clienti non devono gestire alcuna infrastruttura e possono integrare e distribuire in modo sicuro le funzionalità di AI generativa nelle loro applicazioni utilizzando i servizi AWS che già conoscono. Costruito tenendo conto della sicurezza e della privacy, Amazon Bedrock consente ai clienti di proteggere facilmente i dati sensibili.

Amazon Bedrock consente ai clienti di trovare e testare facilmente una selezione di FM all’avanguardia, tra cui i modelli di AI21 Labs, Anthropic, Cohere, Stability AI, Amazon e, nelle prossime settimane, Meta.

Amazon Bedrock è il primo servizio di AI generativa completamente gestito a offrire Llama 2, la nuova generazione di LLM di Meta, attraverso un’API gestita. I modelli Llama 2 presentano miglioramenti significativi rispetto ai modelli Llama originali, tra cui l’addestramento su un numero di dati superiore del 40% e una lunghezza del contesto più lunga, pari a 4.000 token, per lavorare con documenti di dimensioni maggiori. Ottimizzati per fornire una risposta rapida sull’infrastruttura AWS, i modelli Llama 2 disponibili tramite Amazon Bedrock sono ideali per i casi d’uso basati sul dialogo.

Amazon Titan FM sono una famiglia di modelli creati e pre-addestrati da AWS su grandi set di dati, che li rendono potenti e generici per supportare una varietà di casi d’uso. Il primo di questi modelli generalmente disponibile per i clienti, Amazon Titan Embeddings, è un modello linguistico di grandi dimensioni (LLM) che converte il testo in rappresentazioni numeriche chiamate embeddings per alimentare la ricerca, la personalizzazione e i casi d’uso di Retrieval-Augmented Generation (RAG).

Amazon Titan Embeddings supporta più di 25 lingue e una lunghezza del contesto fino a 8.000 token (maggiore è la lunghezza del contesto, migliore è la capacità del modello di comprendere un dialogo o un testo e di generare una risposta corretta), rendendolo adatto a funzionare con singole parole, frasi o interi documenti in base al caso d’uso del cliente.

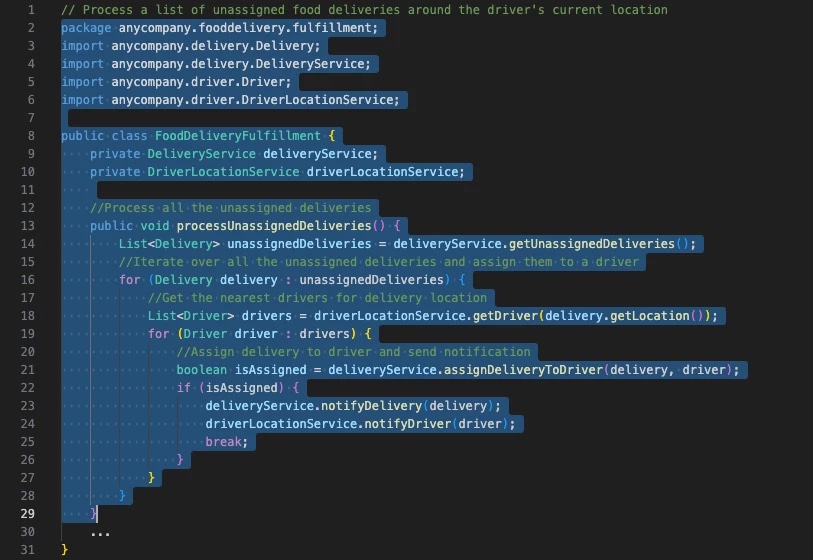

Addestrato su miliardi di righe di codice Amazon e di codice pubblico, Amazon CodeWhisperer è un coding companion basato sull’intelligenza artificiale che migliora la produttività degli sviluppatori. Sebbene gli sviluppatori utilizzino spesso CodeWhisperer per il lavoro quotidiano, a volte hanno bisogno di incorporare in un’applicazione la base di codice interna e privata della loro organizzazione (ad esempio, API interne, librerie, pacchetti e classi), che non è inclusa nei dati di formazione di CodeWhisperer. Tuttavia, il codice interno può essere difficile da utilizzare perché la documentazione può essere limitata e non ci sono risorse pubbliche o forum in cui gli sviluppatori possano chiedere aiuto.

La nuova funzionalità di personalizzazione di Amazon CodeWhisperer sbloccherà il pieno potenziale della programmazione alimentata dall’intelligenza artificiale generativa, sfruttando in modo sicuro la base di codice e le risorse interne del cliente per fornire suggerimenti personalizzati in base alle sue esigenze specifiche. Gli sviluppatori risparmiano tempo grazie a una migliore pertinenza dei suggerimenti di codice per una serie di attività. Per iniziare, un amministratore si collega al proprio repository di codice privato da una fonte, come GitLab o Amazon Simple Storage Service (Amazon S3), e pianifica un lavoro per creare la propria personalizzazione. Costruita tenendo conto della sicurezza e della privacy di livello aziendale, la funzionalità mantiene le personalizzazioni completamente private e il FM sottostante che alimenta CodeWhisperer non utilizza le personalizzazioni per il training, proteggendo la preziosa proprietà intellettuale dei clienti. Questa funzionalità di personalizzazione sarà disponibile ai clienti in anteprima nelle prossime settimane come parte del nuovo CodeWhisperer Enterprise Tier.

Amazon QuickSight è un servizio unificato di business intelligence (BI) costruito per il cloud che offre dashboard interattivi, report impaginati e analisi incorporate, oltre a funzionalità di interrogazione in linguaggio naturale con QuickSight Q, assicurando che ogni utente dell’organizzazione possa accedere alle informazioni di cui ha bisogno nel formato che preferisce.

Gli analisti aziendali spesso trascorrono ore con gli strumenti di BI per esplorare fonti di dati disparate, aggiungere calcoli e creare e perfezionare le visualizzazioni prima di fornirle in dashboard agli stakeholder aziendali. Per creare un singolo grafico, un analista deve innanzitutto trovare la fonte di dati corretta, identificare i campi di dati, impostare i filtri e apportare le personalizzazioni necessarie per garantire che la visualizzazione sia convincente. Se la visualizzazione richiede un nuovo calcolo (ad esempio, le vendite annuali), l’analista deve identificare i dati di riferimento necessari e quindi creare, verificare e aggiungere la visualizzazione al report. Le organizzazioni trarrebbero vantaggio dalla riduzione del tempo che gli analisti aziendali impiegano per creare e aggiustare manualmente grafici e calcoli, in modo da poter dedicare più tempo alle attività di maggior valore.

Le nuove funzionalità di authoring di Generative BI estendono le query in linguaggio naturale di QuickSight Q oltre la risposta a domande ben strutturate (ad esempio, “quali sono i primi 10 prodotti venduti in California?”) per aiutare gli analisti a creare rapidamente elementi visivi personalizzabili da frammenti di domande (ad esempio, “primi 10 prodotti”), chiarire l’intento di una query ponendo domande di follow-up, perfezionare le visualizzazioni e completare calcoli complessi. Gli analisti aziendali descrivono semplicemente il risultato desiderato e QuickSight genera immagini accattivanti che possono essere facilmente aggiunte a un dashboard o a un report con un solo clic.

Infine, AWS ha lanciato Amazon Bedrock—Getting Started, un corso digitale gratuito di autoapprendimento che introduce al servizio. Questo corso di un’ora introdurrà gli sviluppatori e il pubblico tecnico ai vantaggi, alle funzionalità, ai casi d’uso e ai concetti tecnici di Amazon Bedrock.