Più che una vera e propria intervista, quella che abbiamo avuto con Rufus Deuchler, Director, Worldwide Creative Cloud Evangelism, Adobe, è stata una conversazione ad ampio spettro su Firefly, la tecnologia e piattaforma di AI generativa di immagini di Adobe.

Una chiacchierata informale che ha toccato vari temi, tra cui l’impatto dell’intelligenza artificiale generativa sul lavoro dei creativi professionisti, le prospettive di incremento della produttività e di business per le imprese, gli importanti temi della sicurezza e trasparenza, il futuro della creatività e delle tecnologie generative.

1. Le ultime generazioni dei modelli di intelligenza artificiale generativa di immagini, come Firefly Image 2 di Adobe, hanno mostrato un deciso cambio di passo nella qualità. E immaginiamo che da qui in avanti la generazione di immagini non possa che continuare a migliorare ulteriormente. L’AI generativa è una opportunità o una minaccia per i creativi professionisti? Avremo ancora bisogno della creatività umana?

Ah, la grande domanda! Consentimi di iniziare con il dire che è poco meno di un anno che abbiamo lanciato Firefly e sono successe così tante cose. Mi ricordo benissimo la prima volta che ho fatto vedere Firefly a OFFF, a Barcellona, davanti a una platea di creativi: e lì si trattava ancora semplicemente della generazione di immagini tramite prompt di testo. La cosa che più mi affascinava era poi l’integrazione in Photoshop, in illustrator e Adobe Express, per esempio; innovazioni che avevamo anticipato al momento del lancio e che poi sono successe davvero e in tempi rapidi. Ho visto anche un’adozione molto veloce di tutte queste tecnologie, specialmente all’interno di Photoshop, prima nella beta e poi ora grazie alla General Availability: non solo generazione di immagini da zero, ma un uso sempre più massiccio di funzioni come il riempimento generativo o l’estensione generativa delle immagini, che così tante persone stanno integrando tutti i giorni nel loro workflow produttivo.

Questo, tornando alla creatività, inevitabilmente mi fa pensare all’utilità di questi strumenti per i creativi che possono velocizzare processi e operazioni che in passato richiedevano veramente tantissimo tempo. Quindi io vedo l’AI generativa come un vero supporto alla creatività, che aiuta a fare cose noiose e di poco valore più velocemente in modo da poter dedicare più tempo alla creatività pura. Nel corso del tempo, abbiamo visto tanti esempi di tecnologie “disruptive”: pensiamo solo all’avvento della fotografia alla fine dell’Ottocento, quando tutti i ritrattisti pensavano che avrebbero perso il lavoro. Poi però sono arrivati movimenti artistici come l’impressionismo e il cubismo: insomma, la creatività umana si è evoluta anche dopo un cambiamento epocale come l’arrivo della fotografia.

Successivamente, abbiamo visto cose simili con la musica digitale e con i video. Per cui, questa tecnologia non deve essere percepita come una minaccia per la creatività ma anzi come uno strumento per potenziarla e amplificarla. Quello che diciamo spesso in Adobe è che, nei tempi in cui viviamo, la creatività è la nuova produttività: ci sarà sempre più bisogno di persone che siano anche in grado, se si sceglie di usare le tecnologie generative, di essere creative.

L’AI generativa abilita a mio avviso anche una democratizzazione della creatività: queste tecnologie permettono a tantissime persone che prima non avevano accesso a strumenti creativi, oppure che non avevano le capacità o la voglia o il tempo di creare, non solo di farlo, ma anche di farlo molto più velocemente e di arrivare a dei risultati molto buoni in tempi brevi.

2. Hai proprio anticipato la mia seconda domanda, in cui volevo chiederti: uno strumento come Adobe Firefly, può essere considerato anche come una sorta di democratizzazione della creatività? Chiunque ora in azienda può arricchire il proprio lavoro con contenuti visuali dall’aspetto interessante e coinvolgente, con un semplice prompt di testo.

Esattamente. Per farti un esempio sul concetto di “democratizzazione”, noi chiamiamo il nostro sito firefly.adobe.com playground, ovvero il “campo di gioco”, dove ognuno, anche senza avere accesso alla Creative Cloud completa o a determinati programmi della suite, può andare a provare queste tecnologie, per esempio per generare immagini da un prompt di testo oppure provare il riempimento generativo o ancora creare dei testi con delle texture speciali. Insomma, ci si può divertire su questo sito; lo abbiamo progettato in modo che risulti molto intuitivo e facile da usare: si possono applicare degli stili, indicare se vogliamo un’illustrazione o una fotografia, e tanto altro, il tutto tramite dei pulsanti, in maniera molto semplice.

Insomma, è davvero una piattaforma semplice e tutti possono andare a provarla per divertirsi e comprendere la potenza di questa tecnologia.

Sul sito di Firefly abbiamo messo a disposizione anche tutta una serie di contenuti informativi sulla nostra visione, l’approccio responsabile all’AI generativa e su come vediamo il futuro della creatività, affinché tutti possano acquisire consapevolezza.

3. Benché ad attirare l’interesse siano spesso le immagini fantasiose e affascinanti, abbiamo l’impressione che il contributo dell’AI generativa possa andare molto più in profondità, per potenziare e automatizzare il flusso di lavoro dei creativi professionisti. Pensiamo a strumenti come Generative Fill ed Expand o Remove, per non parlare delle potenzialità negli effetti. È corretto?

Sì. Per esempio, proprio l’altra settimana stavo parlando con un grafico e il discorso è andato sull’abbondanza. Prima bisognava ingrandire l’immagine e si perdeva un pezzo dell’immagine stessa. Adesso si può optare per una soluzione più elegante che permette di conservare tutta l’immagine e l’abbondanza può essere “aumentata” in Photoshop, facendo in modo che nessuno possa accorgersi che è stato aggiunto qualcosa all’immagine. Quindi adesso un grafico è in grado di mettere in pagina l’immagine completa senza doverla necessariamente tagliare.

Tanti lavori di ritocco sono stati semplificati, con il Riempimento generativo, e per molte attività che nel passato prendevano letteralmente ore, ad esempio con lo strumento per la clonazione o tecniche del genere per cercare di riparare una parte dell’immagine, ora basta un clic: una parte dell’immagine viene riempita e il creativo professionista può continuare il suo lavoro su aspetti più di valore.

Ritengo molto importante sottolineare che si tratta di una tecnologia che veramente offre un supporto alla creatività – che non è necessariamente quello di creare un’immagine di un gatto con un cappello rosso in un campo di grano –, tramite l’integrazione in Photoshop, ma non solo: anche in Illustrator, dove adesso possiamo generare dei pattern o degli oggetti vettoriali direttamente nell’ambiente di lavoro, oppure anche in Adobe Express.

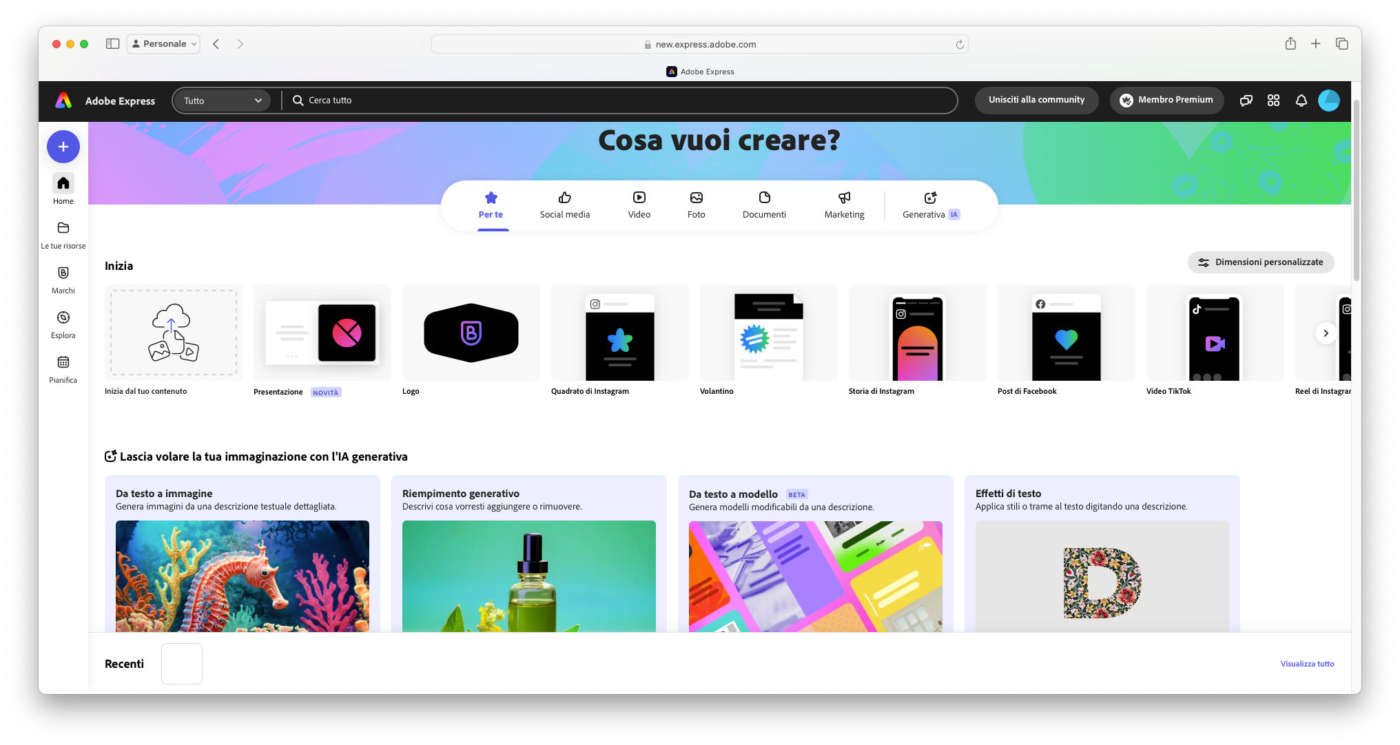

Ed è qui che possiamo a maggior ragione parlare di democratizzazione della creatività. Perché Adobe Express è stato sviluppato proprio per consentire a chiunque di creare delle grafiche, dei layout, dei post social, e rappresenta un caso d’uso molto interessante. L’AI generativa permette a chiunque, tramite un prompt di testo, di generare l’immagine che ha in mente per il suo progetto, senza necessariamente dover cercare su Internet o su un sito di stock per trovare quella giusta. Perché l’immagine giusta è nella nostra mente, e ora possiamo crearla direttamente.

4. Oltre alla piattaforma web di Adobe Firefly, per sbloccare il pieno potenziale dell’AI generativa in un flusso di lavoro creativo professionale è utile che la tecnologia sia integrata negli strumenti desktop della Creative Cloud. Adobe è intenzionata a portare avanti questa integrazione? Con l’evoluzione anche dell’hardware di accelerazione, è ipotizzabile per un prossimo futuro anche l’elaborazione su una workstation in locale?

Siamo in una fase in cui le tecnologie generative hanno bisogno di tanta potenza computazionale; quindi, in questo momento, è necessario che l’elaborazione avvenga su server molto potenti. Nel lungo termine, con Firefly vogliamo consentire ad aziende, fotografi e creativi di poter “insegnare” a Firefly il proprio stile. E di consentire alle aziende di addestrare Firefly sul proprio materiale. Quindi il futuro vedrà un misto tra le due cose: parte dell’elaborazione avverrà sulle proprie macchine, e parte nel cloud.

Una richiesta molto frequente tra i creativi è proprio quella di poter addestrare Firefly sui propri asset… ci stiamo lavorando per consentire loro di avere risultati sempre più personalizzati e in linea con il loro stile.

5. Al di fuori del team creativo, vedete opportunità di business per le imprese nell’AI generativa di immagini? Quali altri professionisti e dipartimenti possono beneficiare dell’uso degli strumenti di Firefly?

Un esempio lampante è la creazione di un PowerPoint, in cui c’è sempre bisogno di immagini di supporto. E anche in casi come questo vedo sempre più spesso delle immagini generate con l’intelligenza artificiale nelle presentazioni aziendali, per raccontare una storia. La generazione di immagini serve proprio a questo: a dare supporto a un’idea, a un concetto, in un formato figurativo, in un modo che rimanga impresso nella memoria e che possa aiutare a spiegare un contenuto. Quindi vedo sempre di più l’utilizzo anche nelle presentazioni aziendali.

Certamente il marketing è un’area che può trarre grossi vantaggi da soluzioni come Firefly perché il mercato richiede una produzione sempre maggiore di contenuti e sempre più in velocità: idee creative, immagini per i social e banner pubblicitari per fare un esempio concreto. Adobe Express può essere di grande aiuto per questi flussi di lavoro. Con la possibilità di avere il logo, i colori e i font dell’azienda tutti disponibili e a portata di mano per creare materiale che sia sempre coerente con il brand e allineato a una idea di design, anche questo tipo di lavoro diventa molto più semplice.

6. Oltre a grandi prospettive, l’AI generativa pone anche alcune sfide. Una di queste concerne la sicurezza e la trasparenza. Adobe è stata sin dall’inizio molto attenta a questo tema ed è tra le aziende promotrici di iniziative quali la Content Authenticity Initiative (CAI), la Coalition for Content Provenance and Authenticity (C2PA) e di tecnologie come Content Credentials. È recente la notizia che anche Google si è unita alla C2PA e la stessa Adobe ha accolto con soddisfazione tale importante adesione. Come state affrontando queste tematiche essenziali? Il settore si sta avvicinando a una risposta comune e standardizzata?

Il nodo cruciale, in termini di sicurezza, è la fonte dei dati su cui l’AI generativa è addestrata. Firefly fa leva su Adobe Stock, su immagini di dominio pubblico con copyright scaduto e banche dati di cui abbiamo acquistato i diritti, questo consente alle aziende di creare immagini senza criticità.

Da anni, inoltre, Adobe sta promuovendo la Content Authenticity Initiative, progetto di cui l’azienda è fondatrice, vale a dire la creazione di uno standard per condividere contenuti digitali trasparenti. Gli asset sviluppati con soluzioni Adobe, infatti, hanno integrate le cosiddette Credenziali di Contenuto, vale a dire una sorta di etichetta informativa con i dettagli sul nome dell’autore, la data, gli strumenti utilizzati per creare un’immagine e le eventuali modifiche apportate all’immagine stessa. Rimangono associate ai contenuti ovunque vengano utilizzati, pubblicati o archiviati, consentendo una corretta attribuzione e aiutando le persone a prendere decisioni consapevoli sui contenuti digitali. All’interno delle Credenziali di Contenuto è anche esplicitato se un asset è stato creato dall’AI generativa.

La Content Authenticity Initiative (CAI) fa parte di un progetto più grande che è la Coalition for Content Provenance and Authenticity (C2PA), in cui ci sono tanti altri player che hanno tutti la stessa esigenza: quella di creare un ambiente sicuro e trasparente, dove l’utente conosce la provenienza delle immagini che sta guardando.

Un‘iniziativa interessante è per esempio la collaborazione con Leica, che per le nuove fotocamere ha deciso di integrare le Content Credentials direttamente nelle immagini al momento dello scatto. Le ragioni dietro alla Content Authenticity Iniziative sono evidenti: ci sono troppe immagini, troppa disinformazione, troppe cose di cui non siamo sicuri. Quindi il concetto di Adobe è proprio quello di permettere alle persone di verificare le fonti prima di fidarsi di ciò che vede.

7. In parte abbiamo già trattato questo tema: un altro timore delle imprese nell’utilizzo di strumenti generativi è quello di poter andare incontro a problematiche legali riguardanti soprattutto il copyright, ma non solo, considerando anche lo scenario normativo internazionale ancora in evoluzione. Come risponde Adobe a questi timori e cosa fa in concreto per supportare le imprese che implementano la sua tecnologia?

Come dicevo prima, il tema fondamentale è la trasparenza sulla fonte di dati da cui l’AI generativa apprende. Spesso, poi, c’è anche un po’ di confusione su come funziona l’intelligenza artificiale. Tanti pensano ancora che, se si chiede per esempio “un topo in un campo di grano”, l’intelligenza artificiale trova una foto di un campo di grano, una foto di un topo, e l’immagine che genera è il mix di queste. Non è assolutamente così, perché quello che fa l’intelligenza artificiale è imparare dei concetti.

Quindi impara com’è un campo di grano, com’è un topo, ma anche, ad esempio, come sarebbe l’ombra di un topo in un campo di grano, e tanti altri dettagli. Tutti questi concetti diversi vengono cristallizzati in un’immagine completamente nuova ed è praticamente impossibile che con lo stesso prompt un’altra persona possa generare esattamente la stessa immagine.

Con Firefly, che si appoggia su Adobe Stock, su immagini di dominio pubblico con copyright scaduto e banche dati di cui abbiamo acquistato i diritti non c’è violazione di copyright.

8. Dopo il testo, il linguaggio naturale e le immagini, sono i video, l’audio e il 3D le prossime frontiere dell’intelligenza artificiale generativa? Qualcosa inizia già a vedersi.

Sì, ad esempio abbiamo annunciato di recente Project Music, per l’editing di file audio tramite prompt testuali e l’integrazione di Firefly all’interno di Substance 3D. Aggiungiamo costantemente nuove funzionalità in Photoshop, in Illustrator, in Adobe Express. L’IA sta entrando in Premiere, in Adobe Podcast, dove consente di ripulire la voce umana e rimuovere il rumore di fondo. Funzionalità di intelligenza artificiale stanno entrando in tutti questi flussi di lavoro.

L’esempio di Acrobat è anch’esso molto interessante, con la possibilità adesso di fare un riassunto di un PDF lungo o di poter porre domande sul testo stesso ed estrarre i punti fondamentali.

Insomma, queste novità legate all’IA le vedremo entrare nei flussi di lavoro molto velocemente. Anche, ovviamente, il video è un ambito importante per Adobe e su cui certamente stiamo lavorando. Tutto sta succedendo molto, molto rapidamente.

9. Dall’inizio di febbraio è disponibile negli Stati Uniti il visore di realtà aumentata Apple Vision Pro. Che opportunità vedete nel nuovo dispositivo Apple e nell’ecosistema dello spatial computing, per le imprese e i professionisti che utilizzano le soluzioni Adobe? Ci sono punti di contatto tra lo spatial computing e l’intelligenza artificiale generativa?

Adobe Firefly è anche un’app che si può usare direttamente nell’Apple Vision Pro, e questo può generare ulteriori opportunità. Apple Vision Pro può infatti essere usato come monitor per il laptop o il desktop consentendo agli utenti di lavorare su schermi molto più grandi in realtà aumentata.

Ci sono grandi possibilità, stiamo vivendo un momento in cui non c’è limite alle idee che è possibile avere. Siamo arrivati a un punto della storia della creativa dell’umanità, in cui qualsiasi cosa pensiamo, probabilmente si può fare.