Come afferma Meta, azienda essa stessa all’avanguardia nello sviluppo dell’intelligenza artificiale e di nuovi strumenti di AI generativa, la differenza tra contenuti umani e sintetici si fa sempre più sottile e di pari passo aumenta il desiderio delle persone di sapere dove si trova il confine.

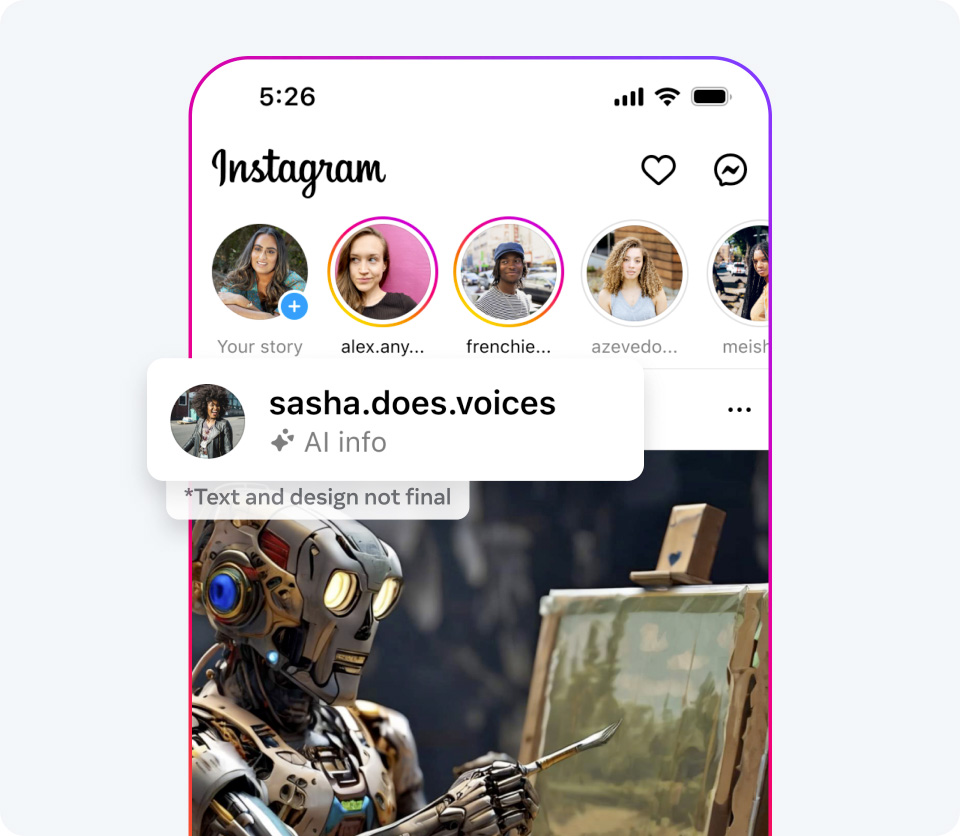

Gli utenti apprezzano la trasparenza su questa nuova tecnologia ed è quindi importante aiutare le persone a capire quando il contenuto fotorealistico che stanno vedendo è stato creato con l’AI. Meta lo fa applicando l’etichetta “Imagined with AI” alle immagini fotorealistiche create con la funzione Meta AI, ma vuole poterlo fare anche con i contenuti creati con gli strumenti di altre aziende.

Per questo la società sta ora collaborando con i partner del settore per allinearsi su standard tecnici comuni che segnalino quando un contenuto è stato creato utilizzando l’AI. La capacità di rilevare questi segnali consentirà a Meta di etichettare le immagini generate dall’AI che gli utenti pubblicano su Facebook, Instagram e Threads.

L’azienda sta sviluppando questa capacità e ha annunciato che nei prossimi mesi inizierà ad applicare le etichette in tutte le lingue supportate da ciascuna app. Questo approccio sarà adottato per tutto il prossimo anno, durante il quale si svolgeranno importanti elezioni in tutto il mondo.

Poiché i contenuti generati dall’intelligenza artificiale sono diffusi a livello globale su Internet, Meta ha lavorato con altre aziende del settore per sviluppare standard comuni per la loro identificazione attraverso forum come la Partnership on AI (PAI). I marcatori invisibili che l’azienda utilizza per le immagini Meta AI – metadati IPTC e watermark invisibili – sono in linea con le best practice della PAI, sottolinea Meta.

La società di Facebook e Instagram sta sviluppando strumenti all’avanguardia in grado di identificare i marcatori invisibili su scala, in particolare le informazioni “AI generated” negli standard tecnici C2PA e IPTC, in modo da poter etichettare le immagini di Google, OpenAI, Microsoft, Adobe, Midjourney e Shutterstock man mano che le altre aziende implementano i loro piani per aggiungere metadati alle immagini create dai loro strumenti.

Se da un lato le aziende stanno iniziando a includere i segnali nei loro generatori di immagini, non hanno ancora iniziato a includerli negli strumenti AI che generano audio e video alla stessa scala, sottolinea Meta, che quindi non può ancora rilevare questi segnali ed etichettare i contenuti di altre aziende. Mentre il settore si adopera per raggiungere questa capacità, Meta sta aggiungendo una funzione che consenta di dichiarare quando si condividono video o audio generati dall’AI, in modo da potervi aggiungere un’etichetta.

Meta chiederà alle persone di utilizzare questo strumento di divulgazione e di etichettatura quando pubblicano contenuti organici con un video fotorealistico o un audio realistico creato o alterato digitalmente, e annuncia che potrebbe applicare delle sanzioni se non lo faranno. Se l’azienda stabilisce che il contenuto di immagini, video o audio creato o alterato digitalmente crea un rischio particolarmente elevato di ingannare materialmente il pubblico su una questione importante, può aggiungere un’etichetta più evidente, se opportuno, in modo che le persone abbiano maggiori informazioni e contesto.

Questo approccio rappresenta lo stato dell’arte di ciò che è tecnicamente possibile in questo momento. Ma non è ancora possibile identificare tutti i contenuti generati dall’AI e ci sono modi in cui le persone possono eliminare i marcatori invisibili, sottolinea Meta. Per questo l’azienda sta valutando una serie di opzioni. Sta lavorando per sviluppare classificatori che aiutino a individuare automaticamente i contenuti generati dall’AI, anche se questi non presentano marcatori invisibili. Allo stesso tempo, sta cercando modi per rendere più difficile la rimozione o l’alterazione dei watermark invisibili.

Ad esempio, l’AI research lab FAIR di Meta ha recentemente condiviso una ricerca su una tecnologia di watermarking invisibile che sta sviluppando, chiamata Stable Signature. Questa tecnologia integra il meccanismo di watermarking direttamente nel processo di generazione dell’immagine per alcuni tipi di generatori di immagini, il che potrebbe essere utile per i modelli open source in modo che il watermarking non possa essere disabilitato.