Ricercatori di Adobe hanno pubblicato un paper di ricerca su Magic Fixup, un modello AI che potrebbe semplificare e trasformare l’editing delle foto sulla base dei dati video, consentendo agli utenti di modificare le immagini con un approccio semplice, simile al taglia-e-incolla, e di correggere le modifiche automaticamente.

Il paper propone un modello generativo che – spiegano i ricercatori Adobe nell’abstract –, data un’immagine modificata in modo approssimativo, sintetizza un output fotorealistico che segue il layout prescritto, seguendo un metodo che trasferisce anche i dettagli più fini dell’immagine originale e conserva l’identità delle sue parti, adattandola tuttavia all’illuminazione e al contesto definito dal nuovo layout.

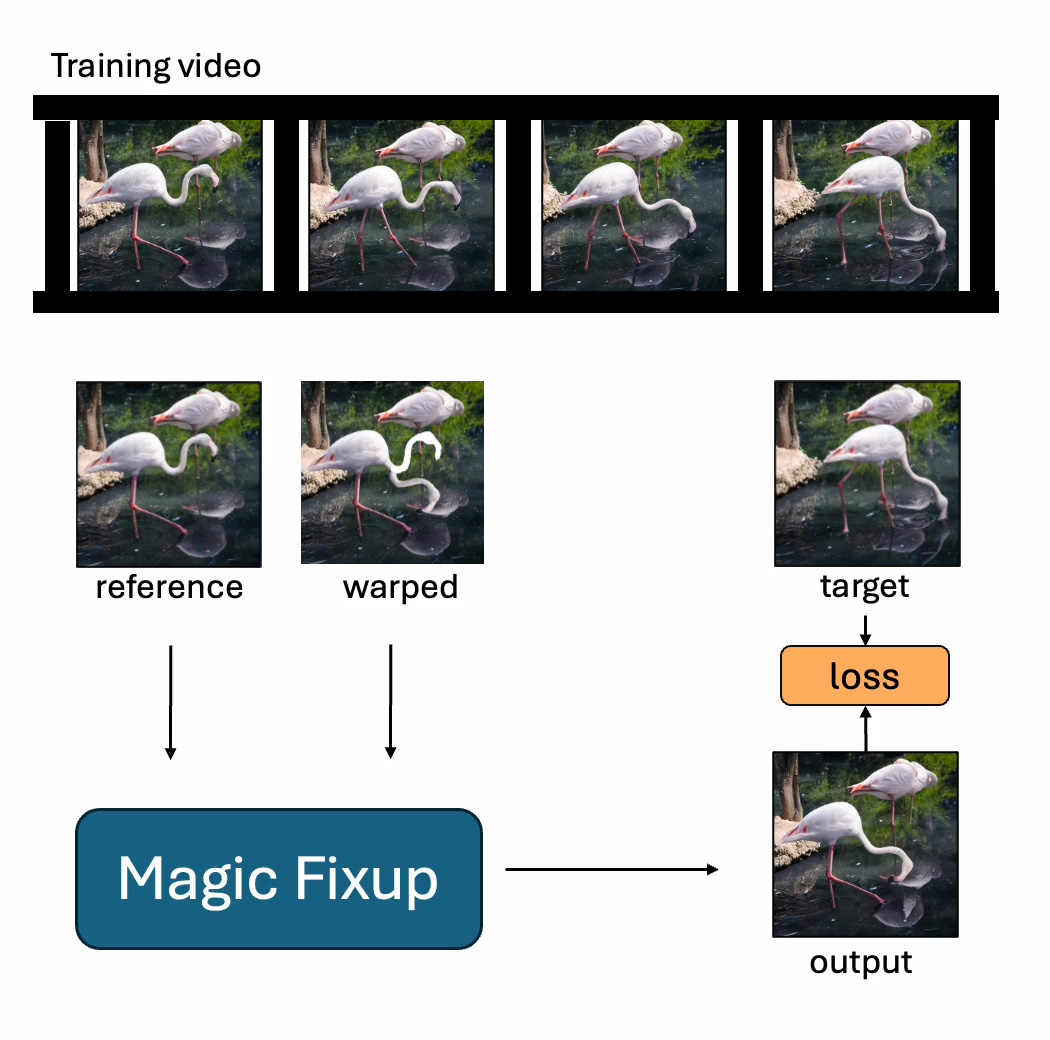

L’intuizione chiave che sta alla base della ricerca su Magic Fixup è che i video sono una potente fonte di supervisione per questo compito: gli oggetti e i movimenti della telecamera forniscono molte osservazioni su come il mondo cambia con il punto di vista, l’illuminazione e le interazioni fisiche. I ricercatori Adobe costruiscono un data set di immagini in cui ogni sample è una coppia di fotogrammi sorgente e target estratti dallo stesso video a intervalli di tempo scelti in modo casuale. Il fotogramma sorgente viene deformato verso il target utilizzando due modelli di movimento che riproducono le modifiche previste dall’utente in fase di test.

Il team supervisiona il modello AI per tradurre l’immagine deformata nella ground truth, partendo da un modello di diffusione preaddestrato. Il design del modello di Adobe – spiega ancora il team di ricercatori – consente esplicitamente il trasferimento di dettagli fini dal fotogramma di origine all’immagine generata, pur seguendo fedelmente il layout specificato dall’utente.

Nel paper i ricercatori Adobe dimostrano che, utilizzando semplici segmentazioni e manipolazioni 2D grossolane, è possibile sintetizzare un montaggio fotorealistico fedele all’input dell’utente, affrontando al contempo effetti di secondo ordine come l’armonizzazione dell’illuminazione e le interazioni fisiche tra gli oggetti modificati.

Questa tecnologia AI sviluppata da Adobe consente ad esempio, riorganizzando spazialmente la scena in modo veloce e approssimativo, di ripulire rapidamente l’editing e renderlo fotorealistico attraverso Magic Fixup, sistemando automaticamente l’illuminazione globale dell’immagine, collegando tra loro i pezzi modificati e spostando gli oggetti in diverse regioni di messa a fuoco.

Il metodo si basa sul presupposto che i video contengono informazioni utili su come gli oggetti si deformano e interagiscono nel mondo reale. Sfruttando questa intuizione, il team di ricercatori utilizza i set di dati video per supervisionare il fotoritocco. Per ogni video, campiona un fotogramma di riferimento e uno di destinazione; poi, fa il warping del fotogramma di riferimento per allinearlo con l’obiettivo e produrre un editing “approssimativo”; quindi, addestra un modello basato sulla diffusione per ripulire l’editing “grezzo” calcolando la perdita di ricostruzione rispetto al fotogramma target come ground truth.