Sottolineando che le capacità multimodali dell’intelligenza artificiale sono state parte integrante dell’espansione delle funzionalità della ricerca, e che il modello Gemini personalizzato per la ricerca ha migliorato in modo significativo la capacità di aiutare le persone a scoprire di più sul web e nel mondo che le circonda, Google ha annunciato che ora sta facendo quello che l’azienda ritiene essere un altro grande passo in avanti con alcuni dei più significativi aggiornamenti della Ricerca. Aggiornamenti che utilizzano l’AI per espandere drasticamente ciò che Google può aiutare a fare, dalla ricerca delle informazioni giuste che servono, all’esplorazione di qualsiasi curiosità venga in mente.

Google stessa è stata pioniera della ricerca visiva anni fa con Google Lens, che aiuta a cercare ciò che si vede con la fotocamera o sullo schermo. Oggi – sottolinea Big G – Lens viene utilizzato per quasi 20 miliardi di ricerche visive al mese: le ricerche con Lens sono uno dei tipi di ricerca in più rapida crescita all’interno della Ricerca e gli utenti più giovani (tra i 18 e i 24 anni) sono quelli che fanno maggiore uso del prodotto.

All’inizio di quest’anno la società americana ha incorporato l’intelligenza artificiale generativa in Google Lens in modo che gli utenti possano puntare la fotocamera, porre una domanda e ottenere una “AI Overview”, una panoramica dell’AI con le informazioni di cui hanno bisogno, insieme a link per saperne di più. E le persone stanno già trovando questa esperienza molto utile, sottolinea l’azienda, secondo cui questa funzione ha fatto aumentare l’utilizzo complessivo di Lens, in quanto le persone sono tornate a chiedere aiuto per domande nuove e più complesse. Ora Google sta introducendo alcuni degli aggiornamenti più significativi fatti finora, per rendere ancora più facile la ricerca nel mondo che ci circonda.

Comprensione dei video in Google Lens

Comprensione dei video in Google Lens

Google ha presentato in anteprima le funzionalità di comprensione dei video all’I/O e ora è possibile utilizzare Lens per effettuare ricerche riprendendo un video e ponendo domande sugli oggetti in movimento che si vedono. L’azienda fa l’esempio che si sia all’acquario e si desideri saperne di più su alcuni pesci interessanti in una delle esposizioni. Basta aprire Lens nell’app Google e tenere premuto il pulsante di scatto per registrare mentre si pone la propria domanda ad alta voce, come ad esempio “perché nuotano insieme?”. Il modello Gemini personalizzato darà un senso al video e alla domanda dell’utente, per produrre una panoramica dell’intelligenza artificiale, insieme a risorse utili provenienti dal web.

Questa funzionalità è disponibile a livello globale nell’app Google (Android e iOS) per gli utenti dei Search Labs iscritti all’esperimento “AI Overviews and more”, con supporto per le query in inglese.

Domande vocali in Lens

Domande vocali in Lens

L’opzione di porre una domanda con la voce è ora disponibile anche ogni volta che si scatta una foto con Lens, rendendo ancora più semplice la ricerca di ciò che si vede. Basta puntare la fotocamera, tenere premuto il pulsante di scatto e chiedere qualsiasi cosa passi per la testa, nello stesso modo in cui si indicherebbe un oggetto per chiederlo a un amico.

L’input vocale per Lens è ora disponibile a livello globale nell’app Google per Android e iOS, per le query in inglese.

Acquistare ciò che si vede con Lens

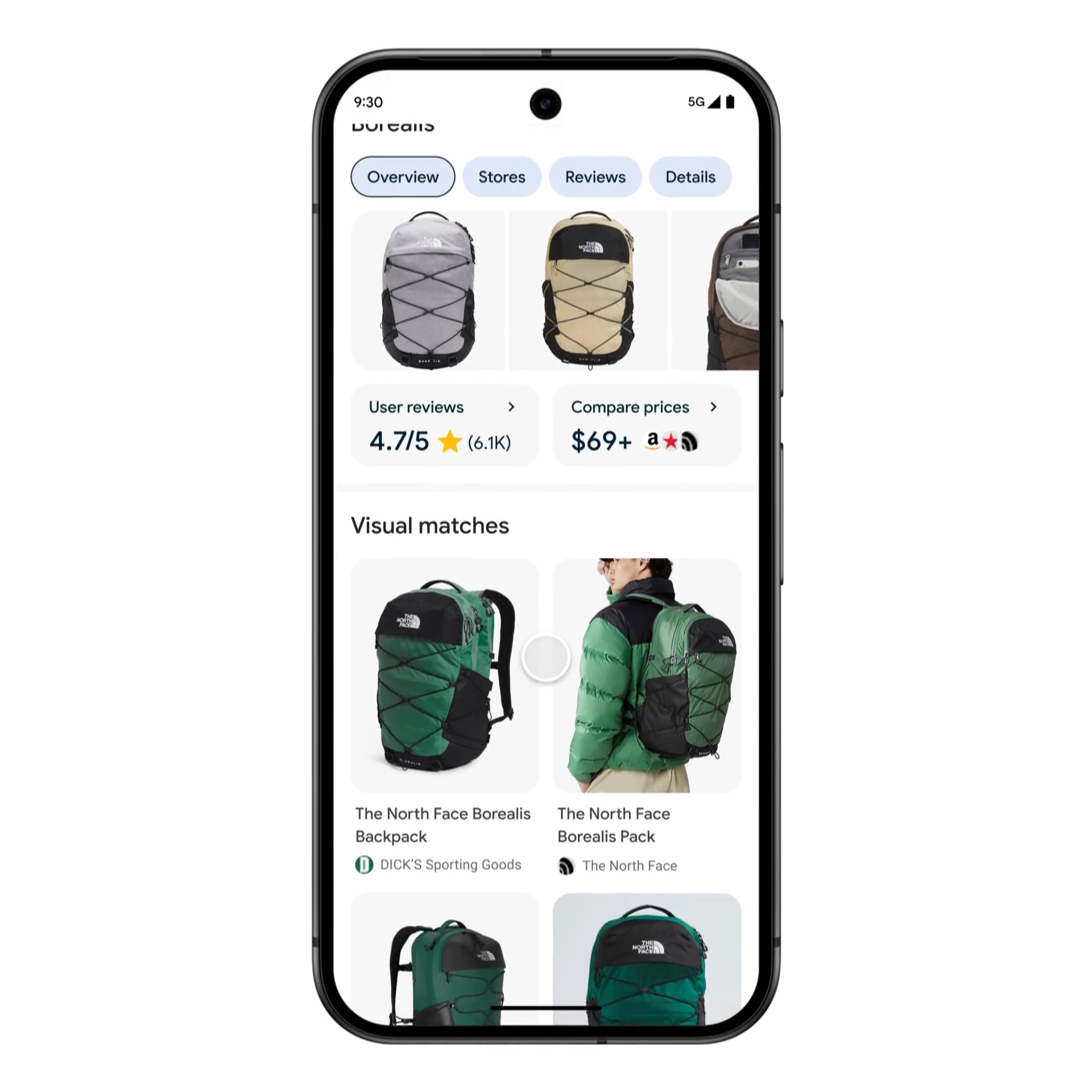

Google sta anche rendendo più facile fare acquisti nel mondo che ci circonda con Lens. Per anni è stato possibile utilizzare Lens per trovare prodotti visivamente simili tra i rivenditori di tutto il web. Ma a partire da questa settimana, gli utenti potranno vedere una pagina di risultati molto più utile che mostra le informazioni chiave sul prodotto cercato, comprese le recensioni, le informazioni sui prezzi dei vari rivenditori e i luoghi di acquisto.

Ad esempio, se si nota un asciugacapelli nel salone del proprio parrucchiere e si desidera comprarne uno uguale, basterà scattare una foto e Lens metterà insieme i modelli avanzati di intelligenza artificiale e lo Shopping Graph di Google, che contiene informazioni su oltre 45 miliardi di prodotti, per identificare l’articolo esatto. In questo modo sarà possibile saperne di più su qualsiasi cosa catturi la nostra attenzione e iniziare a fare acquisti proprio in quel momento.

Cercare una canzone

Che si tratti di un video mentre scorriamo i social media, di un film in streaming o di una pagina web che stiamo visitando, con l’ultimo aggiornamento di Cerchia e Cerca si può cercare istantaneamente le canzoni che ascoltiamo senza dover cambiare app. E Google sta portando Cerchia e Cerca a un numero maggiore di utenti con la sua ultima espansione per Android, ora disponibile su oltre 150 milioni di dispositivi Android.

Pagina dei risultati della ricerca Google organizzata con l’AI

Pagina dei risultati della ricerca Google organizzata con l’AI

All’inizio di quest’anno Google ha mostrato in anteprima come l’intelligenza artificiale può aiutare a esplorare e scoprire una gamma più ampia di risultati dal web per quelle domande che possono essere aperte o che non hanno un’unica risposta giusta, come nel caso in cui si stia cercando un antipasto vegetariano da preparare per una cena.

Questa settimana, negli Stati Uniti, Google sta introducendo le pagine dei risultati di ricerca organizzate con l’intelligenza artificiale, a partire dalle ricette e dall’ispirazione per i pasti su mobile. Utilizzando un modello Gemini personalizzato, ora l’utente vedrà un’esperienza a pagina intera con risultati pertinenti organizzati solo per lui. È possibile esplorare facilmente contenuti e prospettive da tutto il web, compresi articoli, video, forum e altro ancora, tutto in un unico posto.

Nei test – afferma l’azienda –, le persone hanno trovato più utili le pagine dei risultati di ricerca organizzate dall’intelligenza artificiale. Inoltre, con le pagine dei risultati di ricerca organizzate dall’AI, Google vuole offrire alle persone un maggior numero di formati di contenuti e di siti diversi, creando ancora più opportunità di scoperta dei contenuti.

Google afferma di essere consapevole che le persone vogliono andare direttamente alla fonte per molte delle loro domande. Con l’AI nella ricerca, il team si è concentrato sull’aiutare le persone a scoprire contenuti e prospettive da un’ampia gamma di fonti sul web.

Google ha testato un nuovo design per AI Overview che aggiunge collegamenti evidenti alle pagine web di supporto direttamente all’interno del testo di una panoramica AI. Nei test, l’azienda ha notato che questa migliore esperienza ha portato a un aumento del traffico verso i siti web di supporto rispetto al design precedente e che le persone hanno trovato più facile visitare i siti di loro interesse. Sulla base di questa accoglienza positiva, ora Google sta diffondendo questa esperienza a livello globale in tutti i Paesi in cui è disponibile AI Overview.

Inoltre, come è stato condiviso al Google Marketing Live, l’azienda ha testato attentamente gli annunci nelle panoramiche dell’AI per le query pertinenti e ha constatato che le persone trovano utili gli annunci direttamente all’interno delle panoramiche dell’AI perché possono connettersi rapidamente con le aziende, i prodotti e i servizi pertinenti per compiere il passo successivo. A seguito di un feedback positivo, Google sta iniziando a portare gli annunci in AI Overview negli Stati Uniti per le query pertinenti, in modo da poter continuare a mettere in contatto le persone con i prodotti e i marchi utili per le loro ricerche. Per saperne di più, è possibile leggere il post sul blog ufficiale.