Jason Zeiler, Liquid Cooling product manager di Hewlett Packard Enterprise (HPE), spiega perché il futuro del raffreddamento dei data center AI è “liquido”.

L’intelligenza artificiale è uno dei carichi di lavoro più compute-intensive del nostro tempo. Non sorprende che il consumo di energia e i relativi costi energetici dei sistemi di AI aumenteranno. All’inizio di quest’anno, l’Agenzia Internazionale per l’Energia (AIE) ha riferito che i data center, a livello globale, hanno utilizzato il 2% di tutta l’elettricità nel 2022 e prevede che tale percentuale potrebbe più che raddoppiare entro il 2026.

Sebbene negli acceleratori di nuova generazione l’efficienza sia migliorata, il consumo di energia si intensificherà con l’adozione dell’AI. I data center dovranno gestire i carichi di lavoro dell’AI in modo più efficiente e le strutture odierne non sono attrezzate per supportare le esigenze di raffreddamento della crescente potenza dei processori.

È qui che entra in gioco il raffreddamento a liquido.

Restare freddi nell’era dell’intelligenza artificiale

Rispetto al tradizionale raffreddamento ad aria, che utilizza ventole, con il raffreddamento a liquido – e in particolare con il raffreddamento diretto a liquido – il refrigerante viene pompato direttamente nel server, per assorbire il calore emesso dai processori, e trasferito a un sistema di scambio termico all’esterno del data center.

HPE vanta decenni di esperienza nell’innovazione e nella fornitura di sistemi raffreddati a liquido in tutto il mondo, creati per operare in modo efficiente in sistemi su larga scala che eseguono carichi di lavoro HPC (High Performance Computing).

Le future infrastrutture per l’AI, che utilizzeranno gli acceleratori più recenti, richiederanno queste innovative tecnologie di raffreddamento a liquido per risolvere i problemi di efficienza energetica, sostenibilità e anche resilienza del sistema che è fondamentale per mantenere in funzione i carichi di lavoro dell’intelligenza artificiale.

Analizziamo i quattro motivi principali per cui il raffreddamento a liquido è la soluzione ideale per i data center AI.

Alcuni chip non sopportano il calore

I nostri amici che lavorano in questo settore hanno fatto un lavoro straordinario nella progettazione degli acceleratori di nuova generazione, per offrirci prestazioni incredibilmente elevate per l’AI con una maggiore efficienza.

I nuovi chip sono progettati per racchiudere ancora più prestazioni in un ingombro ridotto, ma questo significa anche che diventerà difficile raffreddare tutti i componenti critici al loro interno.

Se non riusciamo a raffreddare i chip abbastanza velocemente, i data center potrebbero avere problemi di surriscaldamento che causerebbero guasti al sistema e, in ultima analisi, tempi di inattività non pianificati per l’esecuzione di lavori di AI.

Il raffreddamento a liquido può raffreddare questi chip in modo più rapido ed efficiente, poiché l’acqua ha una capacità termica tre volte superiore a quella dell’aria, consentendo di assorbire una quantità maggiore di calore emesso dagli acceleratori e da altri componenti come CPU, memoria e switch di rete.

Realizzare il valore dell’AI con un minore impatto ambientale

Realizzare il valore dell’AI con un minore impatto ambientale

Raffreddare in modo efficiente gli acceleratori di nuova generazione per garantire l’affidabilità del sistema è una priorità fondamentale, ma è altrettanto importante che lo facciamo in modo più sostenibile nei confronti di Madre Natura.

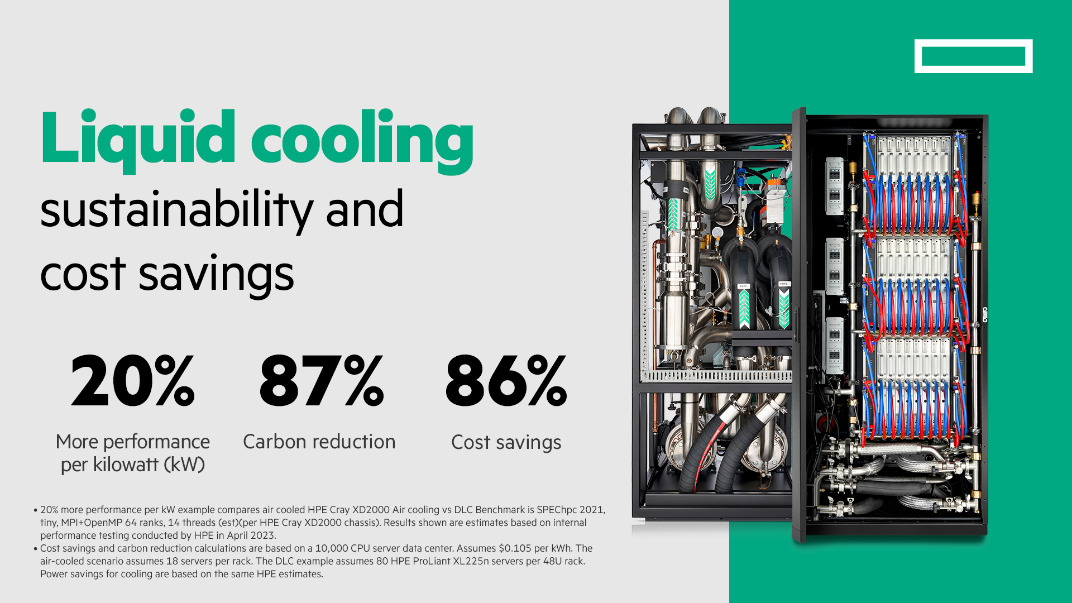

Il raffreddamento a liquido presenta notevoli vantaggi in termini di sostenibilità e di costi per gli acceleratori di nuova generazione.

Prendiamo ad esempio un data center HPC con 10.000 server.

Se tutti i 10.000 server fossero raffreddati ad aria, il data center emetterebbe più di 8.700 tonnellate di CO2. Se i server fossero raffreddati a liquido, emetterebbe invece circa 1.200 tonnellate di CO2 all’anno [sulla base di dati interni di HPE, ndr]. Si tratta di una riduzione dell’energia dell’87% che evita il rilascio di circa 7700 tonnellate di CO2 all’anno nell’atmosfera.

Questo massiccio risparmio energetico si accompagna naturalmente a un enorme risparmio economico. Qualsiasi direttore finanziario che controlla le spese energetiche lo apprezzerà.

Con un data center da 10.000 server raffreddati a liquido, un data center pagherà annualmente solo 45,99 dollari per server, rispetto al costo annuale di 254,70 dollari per server con raffreddamento ad aria. Ciò consente di risparmiare quasi 2,1 milioni di dollari all’anno in costi operativi.

Riutilizzare l’energia dei sistemi di intelligenza artificiale

Le meraviglie non si fermano qui. Il raffreddamento a liquido produce ulteriori benefici.

Dopo aver catturato il calore, le soluzioni di raffreddamento a liquido lo trasferiscono a un sistema di scambio all’esterno del data center, dove l’acqua riscaldata può essere riutilizzata come fonte di energia per alimentare altri edifici o strutture.

Il National Renewable Energy Laboratory (NREL) del Dipartimento dell’Energia degli Stati Uniti lo ha fatto con successo per anni. Il laboratorio, che è uno dei principali centri di energia rinnovabile del mondo, ha riutilizzato il 90% dell’acqua riscaldata catturata dal suo sistema Peregrine, un supercomputer HPE Cray raffreddato a liquido, come fonte di calore primaria per gli uffici e i laboratori della Energy Systems Integration Facility (ESIF).

Anche i nostri amici di QScale, in Québec, hanno già in programma di farlo, ma per aiutare a coltivare prodotti e affrontare la scarsità di cibo. Utilizzando il raffreddamento a liquido, QScale spera di alimentare le serre locali, grandi quasi come 100 campi da calcio, per produrre l’equivalente di 80.000 tonnellate di pomodori all’anno.

Allo stesso modo, in Norvegia, il nostro partner Green Mountain intende fornire l’acqua riscaldata per sostenere gli sforzi di allevamento ittico di Hima, il più grande allevamento terrestre di trote al mondo, basato su sistemi di acquacoltura a ricircolo (RAS), una tecnologia che ricircola acqua pura e pulita di montagna. Hima punta a produrre circa 8.000 tonnellate di trote Hima di prima qualità, equivalenti a 22.000.000 di cene all’anno.

Più prestazioni AI, sistemi più piccoli

In vista della prossima adozione, da parte dei data center, delle infrastrutture per l’AI, la densità sarà un fattore chiave per fare spazio alle soluzioni avanzate di intelligenza artificiale.

Poiché per il raffreddamento a liquido non sono necessarie né le ventole né le apparecchiature di supporto tipiche delle soluzioni raffreddate ad aria, i data center possono massimizzare lo spazio o espandersi, secondo le necessità, potendo utilizzare rack di server più densi e in numero inferiore.

Utilizzando l’esempio di un data center da 10.000 server, con i server raffreddati a liquido una struttura riduce del 77,5% lo spazio necessario.

Inoltre, nell’arco di cinque anni, le soluzioni con raffreddamento a liquido utilizzano il 14,9% in meno di potenza dello chassis, offrendo prestazioni superiori del 20,7% per kW rispetto alle soluzioni con raffreddamento ad aria.

L’AI richiede esperienza e affidabilità

L’AI richiede esperienza e affidabilità

Quando si parla di AI, conviene affidarsi agli esperti. HPE vanta oltre 50 anni di esperienza e più di 300 brevetti nel settore del raffreddamento a liquido.

Continuiamo a costruire grandi sistemi raffreddati a liquido per i nostri clienti, che possono operare per diversi anni consecutivi senza alcun problema. Le nostre soluzioni con raffreddamento a liquido hanno anche dimostrato di contribuire a un’IT più sostenibile.

Negli ultimi due anni abbiamo consegnato quattro dei dieci sistemi più veloci al mondo, tutti supercomputer HPE Cray EX raffreddati a liquido.

Tra questi, Frontier, il supercomputer più veloce al mondo per l’Oak Ridge National Laboratory del Dipartimento dell’Energia degli Stati Uniti, ha compiuto un’impresa ingegneristica infrangendo la barriera della velocità exascale, facendo funzionare decine di migliaia di acceleratori senza guasti. Malgrado queste prestazioni impressionanti, Frontier ha ottenuto il titolo di supercomputer numero uno al mondo per efficienza energetica.

Quindi, sappiamo bene cosa serve per costruire e gestire in modo efficiente sistemi ad alta intensità di calcolo. Ci siamo preparati a lungo per l’AI e siamo pronti a continuare a supportare i clienti nel loro percorso in questo ambito con le soluzioni di raffreddamento più sofisticate al mondo.