In occasione dell’undicesimo anniversario di Connect, il fondatore e CEO di Meta, Mark Zuckerberg, ha condiviso le ultime novità e gli sviluppi in materia di realtà mista, IA e dispositivi indossabili, tutti elementi che contribuiscono alla visione dell’azienda di un futuro aperto e più connesso.

Per quanto riguarda la realtà mista, la società di Mark Zuckerberg ha in primo luogo presentato Meta Quest 3S, l’headset per la mixed reality più conveniente dell’azienda, con un costo di partenza di 329,99 euro, che rende la realtà mista di alto livello accessibile a più persone che mai. È possibile preordinare il proprio visore già da oggi, mentre l’arrivo sul mercato è previsto per il prossimo 15 ottobre.

Quest 3S presenta le stesse caratteristiche distintive di Quest 3, sottolinea Meta: realtà mista ad alta risoluzione e a colori, che consente di fondere perfettamente il mondo fisico e quello virtuale, grazie alla piattaforma Snapdragon XR2 Gen 2 sviluppata in stretta collaborazione con Qualcomm Technologies. Il dispositivo mette a disposizione degli utenti il tracciamento delle mani per interazioni naturali e i controller Touch Plus per una maggiore precisione. Gli utenti potranno accedere all’intera gamma di esperienze disponibili su Meta Horizon OS, tra cui intrattenimento, fitness, giochi, produttività, esperienze social e altro ancora. E il visore migliorerà nel tempo grazie a regolari aggiornamenti del software.

Quest 3S presenta le stesse caratteristiche distintive di Quest 3, sottolinea Meta: realtà mista ad alta risoluzione e a colori, che consente di fondere perfettamente il mondo fisico e quello virtuale, grazie alla piattaforma Snapdragon XR2 Gen 2 sviluppata in stretta collaborazione con Qualcomm Technologies. Il dispositivo mette a disposizione degli utenti il tracciamento delle mani per interazioni naturali e i controller Touch Plus per una maggiore precisione. Gli utenti potranno accedere all’intera gamma di esperienze disponibili su Meta Horizon OS, tra cui intrattenimento, fitness, giochi, produttività, esperienze social e altro ancora. E il visore migliorerà nel tempo grazie a regolari aggiornamenti del software.

I cambiamenti principali riguardano il design dei visori, le lenti Fresnel e un campo visivo leggermente più ridotto. Il modello base Quest 3S da 128 GB, il modello da 256 GB con più spazio di archiviazione, e il top di gamma Quest 3 da 512GB (al nuovo prezzo ridotto di 549,99 euro), costituiscono ora la collezione di visori MR (Mixed Reality) di Meta. E, per un periodo di tempo limitato, Batman: Arkham Shadow è incluso con ogni nuovo acquisto di ciascuna delle tre versioni del visore.

Inoltre, esistono molti altri contenuti da esplorare già dal primo giorno. Dai servizi di streaming, come le nuove app di Prime Video, Amazon Music e Twitch, alle app per il fitness. Meta ha anche lavorato con Microsoft per aggiornare Remote Desktop. Presto sarà anche possibile collegare qualsiasi computer con Windows 11 ai visori Quest: basta inquadrare la tastiera per avviare l’associazione. Che si desideri lavorare su enormi schermi virtuali o concentrarsi sui propri progetti senza distrazioni, Quest può essere un’estensione naturale del proprio PC.

Meta sottolinea che ciò che l’azienda sta costruendo non è la prossima piattaforma di gaming, ma la prossima piattaforma informatica. Sarà possibile guardare film, ascoltare musica, lavorare con fogli di calcolo, giocare con gli amici, passare il tempo e connettersi. E Meta sta rendendo più semplice che mai per gli sviluppatori creare contenuti per Horizon OS, in modo che ci possano essere ancora più contenuti interessanti. Secondo Meta, tutto ciò che può fare il computer, i visori MR dell’azienda potranno farlo meglio, grazie al valore della presenza.

Meta sottolinea che ciò che l’azienda sta costruendo non è la prossima piattaforma di gaming, ma la prossima piattaforma informatica. Sarà possibile guardare film, ascoltare musica, lavorare con fogli di calcolo, giocare con gli amici, passare il tempo e connettersi. E Meta sta rendendo più semplice che mai per gli sviluppatori creare contenuti per Horizon OS, in modo che ci possano essere ancora più contenuti interessanti. Secondo Meta, tutto ciò che può fare il computer, i visori MR dell’azienda potranno farlo meglio, grazie al valore della presenza.

A proposito di presenza, l’azienda sta migliorando anche quella: sta infatti lavorando per portare gli spazi fotorealistici nel metaverso, consentendo un nuovo modo profondo di essere insieme in spazi che sembrano e danno la sensazione di essere fisicamente presenti: Meta lo chiama Hyperscape. Utilizzando lo Splatting gaussiano, una tecnica di rendering volumetrico in 3D, Meta sfrutta il cloud rendering e lo streaming per rendere questi spazi visualizzabili su un visore Quest 3 standalone. L’azienda sta lanciando una demo per i visori Quest 3 negli Stati Uniti che mostra alcune di queste repliche digitali, tra cui lo studio dell’artista Daniel Arsham, come è stato mostrato durante il keynote, in modo che gli utenti possano sperimentare di persona. In futuro, i creator potranno costruire mondi all’interno di Horizon, utilizzando un telefono per scansionare una stanza e poi ricrearla, portando con facilità gli spazi fisici nel mondo digitale.

Intelligenza artificiale, un impulso concreto

Intelligenza artificiale, un impulso concreto

Dal suo lancio nel 2023, sottolinea l’azienda, Meta AI si è distinta per aver dato alle persone un accesso illimitato e gratuito all’intelligenza artificiale di ultima generazione. Secondo l’azienda è sulla buona strada per diventare l’assistente AI più utilizzato al mondo entro la fine di quest’anno. Più di 400 milioni di persone lo usano già ogni mese e 185 milioni di persone lo utilizzano ogni settimana sui prodotti Meta, che ora lo sta rendendo più divertente, utile e capace.

L’azienda sta rendendo più naturali le interazioni con Meta AI, aggiungendo un supporto vocale. Sarà possibile parlare con Meta AI utilizzando Facebook, Messenger, WhatsApp e i DM di Instagram, e l’AI risponderà. Presto, delle voci iconiche come quelle di Awkwafina, Dame Judi Dench, John Cena, Keegan Michael Key e Kristen Bell daranno vita al proprio assistente IA intelligente, aggiungendo un po’ di divertimento. Gli aggiornamenti di Meta AI per il supporto vocale sono però disponibili solo in Australia, Canada, Nuova Zelanda e negli Stati Uniti solamente in lingua inglese.

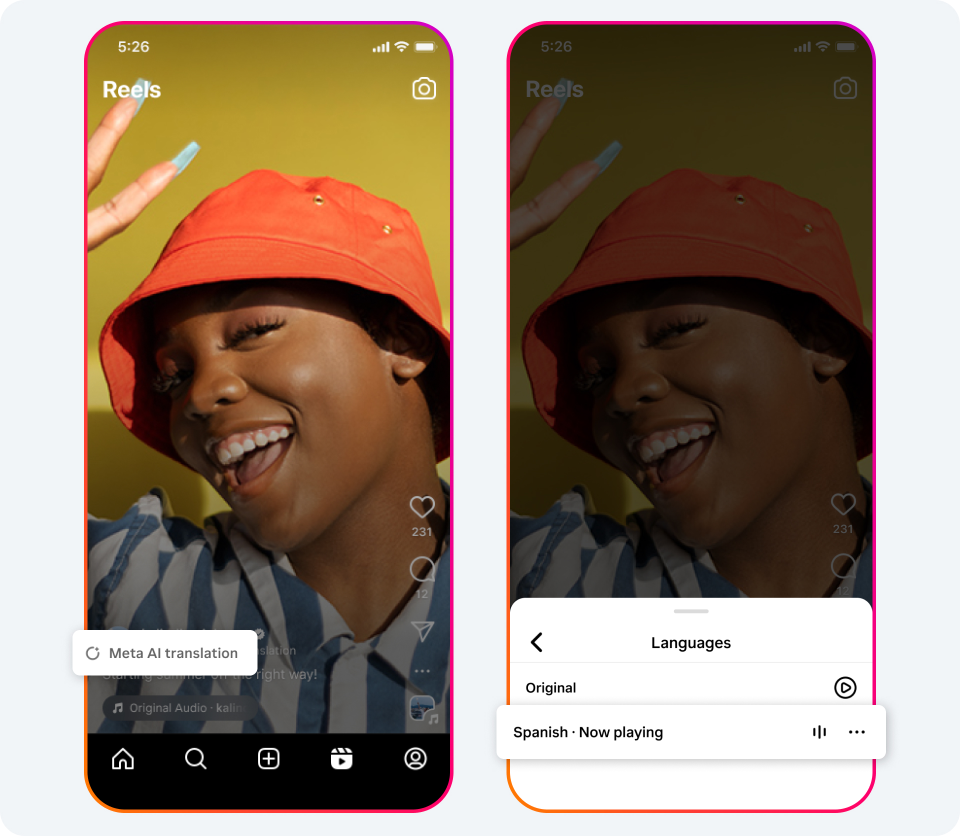

Meta sta inoltre sperimentando il doppiaggio automatico dei video e il sincronismo labiale in lingua inglese e spagnola per aiutare le persone a vedere più contenuti nella loro lingua madre nei Reel di Instagram e Facebook. Sta iniziando con un piccolo gruppo di creator su Instagram e spera di rendere disponibile la funzionalità ad altri altri creator e in altre lingue. Questo dovrebbe consentire ai creator di raggiungere molte più persone in tutto il mondo, indipendentemente dalla lingua che parlano.

Meta sta inoltre sperimentando il doppiaggio automatico dei video e il sincronismo labiale in lingua inglese e spagnola per aiutare le persone a vedere più contenuti nella loro lingua madre nei Reel di Instagram e Facebook. Sta iniziando con un piccolo gruppo di creator su Instagram e spera di rendere disponibile la funzionalità ad altri altri creator e in altre lingue. Questo dovrebbe consentire ai creator di raggiungere molte più persone in tutto il mondo, indipendentemente dalla lingua che parlano.

L’azienda sta aggiungendo nuove funzionalità ai suoi strumenti di editing basati sull’IA. Poiché Meta AI è ora in grado di elaborare informazioni visive, è possibile porre domande relative alle immagini caricate. Ad esempio, scattare una foto di un fiore appariscente durante un’escursione e chiedere a Meta AI di identificarlo. Oppure caricare la foto di un piatto gustoso e chiedere a Meta AI di trovare la ricetta. È anche possibile caricare una foto e apportare modifiche precise con Meta AI utilizzando un linguaggio colloquiale. Mentre prima era possibile modificare solo le immagini generate da Meta AI, ora è possibile aggiungere, rimuovere o cambiare elementi di una propria foto reale con facilità.

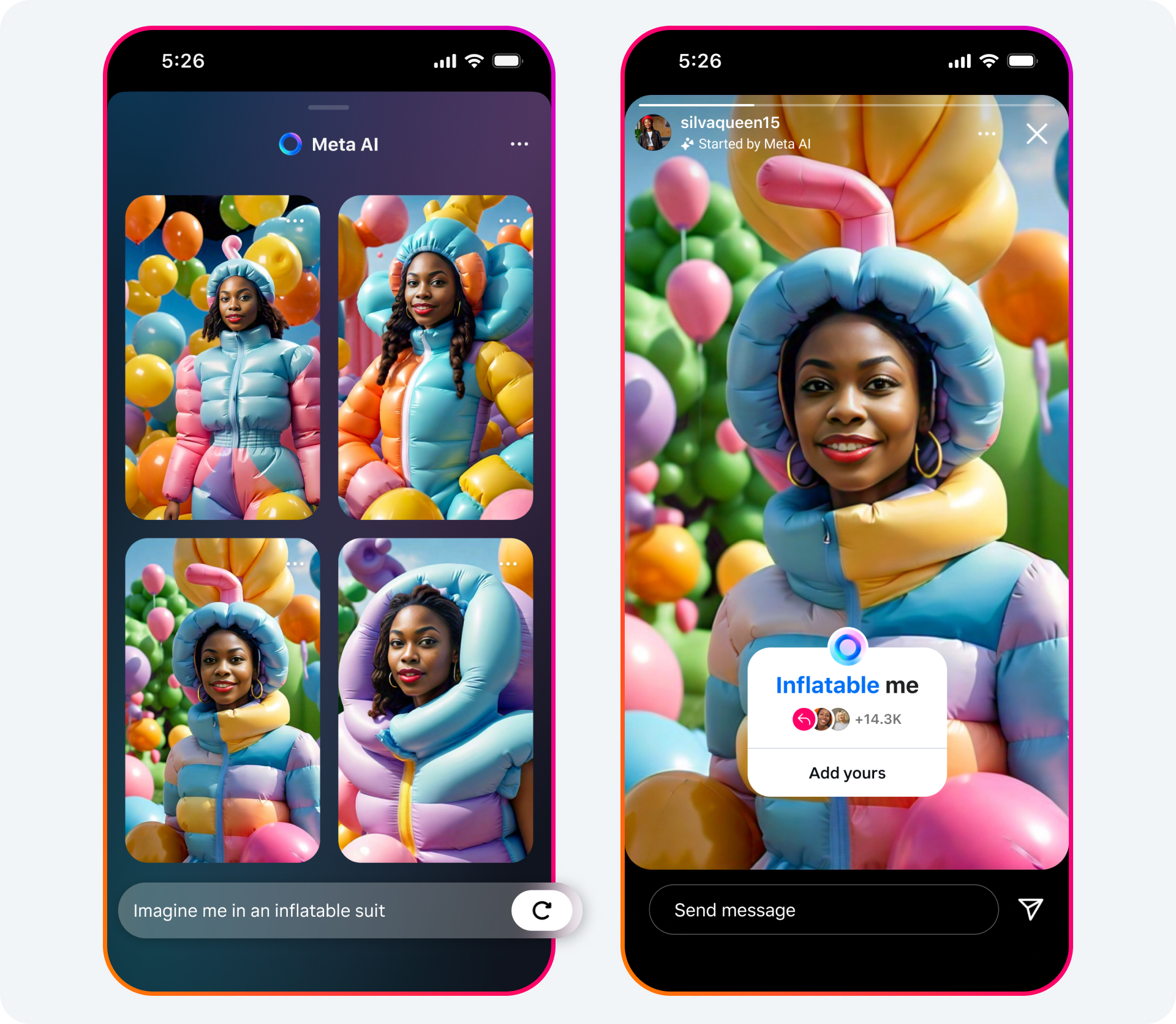

Meta sta ampliando le funzionalità Imagine di Meta AI, permettendo di immaginare sé stessi nelle Storie, nei post del feed e nella propria foto profilo su Facebook e Instagram. Sarà poi possibile condividere facilmente i selfie generati dall’IA in modo che gli amici possano vederli, reagire o imitarli. Meta AI può ora suggerire didascalie per le Storie su Facebook e Instagram. Basta scegliere un’immagine e la tecnologia di IA multimodale genererà delle didascalie tra cui scegliere, adatte all’immagine.

L’azienda sta aggiungendo temi generati dall’Intelligenza Artificiale per le chat di Messenger e Instagram, in modo che si possa creare l’atmosfera perfetta per sé stessi e per il proprio gruppo. E sta testando nuovi contenuti generati da Meta AI nei feed di Facebook e Instagram. È possibile cliccare un suggerimento per modificare un contenuto, oppure scorrere con il dito per creare nuovi contenuti in tempo reale. Alcune immagini saranno basate sui propri interessi, in modo che si possa approfondire ciò che ci piace. In altre, invece, ci saranno gli stessi utenti, in modo che possano essere i protagonisti della propria storia e condividere le proprie foto preferite con gli amici.

L’azienda sta aggiungendo temi generati dall’Intelligenza Artificiale per le chat di Messenger e Instagram, in modo che si possa creare l’atmosfera perfetta per sé stessi e per il proprio gruppo. E sta testando nuovi contenuti generati da Meta AI nei feed di Facebook e Instagram. È possibile cliccare un suggerimento per modificare un contenuto, oppure scorrere con il dito per creare nuovi contenuti in tempo reale. Alcune immagini saranno basate sui propri interessi, in modo che si possa approfondire ciò che ci piace. In altre, invece, ci saranno gli stessi utenti, in modo che possano essere i protagonisti della propria storia e condividere le proprie foto preferite con gli amici.

L’azienda ha appena rilasciato le nuove versioni di Llama 3.2. Llama 3.2 è il primo modello visivo di rilievo di Meta, il che significa che è in grado di comprendere sia input visivi che testuali. Per aggiungere il supporto delle immagini a Llama, Meta ha addestrato una serie di parametri adattivi che si integrano con i modelli esistenti di sola elaborazione testo con 8B e 70B parametri, in modo da creare modelli da 11B e 90B parametri che siano in grado di riconoscere anche le immagini. Inoltre, l’azienda continua a migliorare l’intelligenza, soprattutto per quanto riguarda i processi di ragionamento, rendendo questi modelli i più avanzati rilasciati finora.

Meta sta anche rilasciando modelli super piccoli di 1B e 3B parametri, ottimizzati per funzionare su dispositivi come uno smartphone o, eventualmente, un paio di occhiali.

Meta ritiene che l’IA open source sia la strada giusta da percorrere. È più conveniente, personalizzabile, affidabile e più performante rispetto alle alternative. E continuerà a sviluppare Llama in modo responsabile, con continui miglioramenti e nuove funzionalità.

Meta e il mondo dei dispositivi indossabili

Meta e il mondo dei dispositivi indossabili

Ci sono molte novità anche per i fan degli occhiali Ray-Ban Meta. L’azienda sta lavorando per offrire nuove integrazioni con Spotify, Audible e iHeart. E sta migliorando l’esperienza degli occhiali con l’assistente intelligente, Meta AI.

L’azienda sta rendendo l’interazione più colloquiale e naturale. Invece di dover dire “Hey Meta” per ogni domanda, si può iniziare una conversazione con una parola di attivazione e poi continuando a parlare come si farebbe normalmente, con le domande successive.

Gli occhiali potranno aiutare anche a ricordare le cose: ad esempio dove abbiamo parcheggiato. È possibile utilizzare la voce per impostare un promemoria che ci ricordi di inviare un messaggio ad esempio dopo tre ore. Gli occhiali possono anche eseguire azioni basate sul testo che l’utente sta guardando, come chiamare un numero di telefono presente su un volantino o scansionare un codice QR.

L’azienda sta aggiungendo il supporto per l’input video di Meta AI, in modo da ottenere un aiuto continuo in tempo reale. Ad esempio, se si sta esplorando una nuova città, basta chiedere a Meta AI di seguirci e chiedere informazioni sui monumenti che vediamo, o per avere idee su cosa vedere dopo, realizzando il nostro tour guidato a mani libere.

Gli occhiali saranno presto in grado di tradurre i discorsi in tempo reale. Quando parliamo con qualcuno in spagnolo, francese o inglese, sentiremo quello che dice in italiano attraverso gli altoparlanti degli occhiali. Questo non solo è ottimo per viaggiare, ma dovrebbe contribuire ad abbattere le barriere linguistiche e ad unire le persone. Meta ha in programma di aggiungere il supporto per altre lingue in futuro, per rendere questa funzione ancora più utile.

Meta sta poi collaborando con Be My Eyes, un’applicazione gratuita che mette in contatto persone non vedenti e ipovedenti con volontari tramite un video in diretta, in modo che possano descrivere ciò che hanno davanti a loro. Grazie agli occhiali, il volontario può vedere facilmente il punto di vista dell’utente e parlargli di ciò che lo circonda.

Meta sta poi collaborando con Be My Eyes, un’applicazione gratuita che mette in contatto persone non vedenti e ipovedenti con volontari tramite un video in diretta, in modo che possano descrivere ciò che hanno davanti a loro. Grazie agli occhiali, il volontario può vedere facilmente il punto di vista dell’utente e parlargli di ciò che lo circonda.

La nuova gamma di lenti Transitions di EssilorLuxottica entra a far parte della collezione Ray-Ban Meta, offrendo ancora più opzioni per scegliere l’occhiale perfetto. Inoltre, Meta lanciando un nuovo set in edizione limitata di montature Shiny Transparent Wayfarer, per mostrare la tecnologia al loro interno.

Ecco Orion: i primi occhiali AR di Meta

Ecco Orion: i primi occhiali AR di Meta

Infine, Meta ha presentato Orion, un prototipo di prodotto a cui l’azienda sta lavorando da 10 anni. I requisiti erano semplici: dovevano essere occhiali, non visori, senza fili e con un peso inferiore ai 100 grammi. Dovevano avere display ad ampio campo visivo, sufficientemente luminosi da consentire una visione chiara in condizioni di luce diversificate e sufficientemente grandi da poter ospitare schermi multipli per il multitasking o uno schermo di dimensioni cinematografiche per l’intrattenimento. E dovevano permettere a chi li utilizza di vedere il mondo fisico che li circonda. Non una rappresentazione del mondo fisico tramite Passthrough. Il mondo fisico vero e proprio con contenuti digitali sovrapposti.

Dovevano avere controlli vocali e il tracciamento delle mani e degli occhi per aiutare le persone a navigare nell’interfaccia utente. Ma Meta voleva anche un modo per comunicare con gli occhiali in modo discreto, privato e socialmente accettabile. Serviva, quindi, anche una nuova interfaccia.

Orion soddisfa tutte queste esigenze, afferma l’azienda. È un’opera di miniaturizzazione con 10 chip di silicio personalizzati e un’architettura del display completamente nuova. Include un braccialetto EMG per un input continuo. Ed è un prototipo di prodotto finito e fattibile. Questo non è solo un assaggio di ciò che potrebbe essere possibile in futuro: è uno sguardo alla realtà che è già a portata di mano.

Con Orion, Meta dichiara di essere considerevolmente più vicina alla realizzazione della prossima fase dell’informatica che abbia al centro le persone, in cui prevalga un forte senso di presenza, in qualsiasi parte del mondo ci si trovi.

Sul sito di Meta sono disponibili maggiori informazioni su Orion.