Il team di Stability AI ha annunciato il rilascio del modello aperto SDXL 1.0, la successiva iterazione nell’evoluzione dei modelli generativi text-to-image.

Dopo il rilascio limitato, riservato alla ricerca, di SDXL 0.9, la versione completa di SDXL è stata migliorata per diventare il miglior modello aperto di generazione di immagini al mondo, afferma la startup specializzata in AI generativa.

SDXL 1.0 viene descritto dall’azienda sviluppatrice come il modello per le immagini flagship di Stability AI e il miglior modello open per la generazione di immagini. Il team lo ha testato rispetto a vari altri modelli e i risultati secondo Stability AI sono conclusivi: le persone preferiscono le immagini generate da SDXL 1.0 rispetto ad altri modelli aperti. Questa ricerca è il risultato di settimane di dati di preferenza acquisiti da generazioni di modelli sperimentali sul Discord dell’azienda e da test esterni.

Stability AI afferma che SDXL genera immagini di alta qualità praticamente in qualsiasi stile artistico ed è il miglior modello aperto per il fotorealismo. È possibile creare immagini distinte senza che il modello impartisca alcuna sensazione particolare, garantendo un’assoluta libertà di stile. SDXL 1.0 è messo a punto particolarmente bene per ottenere colori vibranti e accurati, con contrasto, illuminazione e ombre migliori rispetto al suo predecessore, il tutto con una risoluzione nativa di 1024×1024.

Inoltre, SDXL è in grado di generare concetti notoriamente difficili da rendere per i modelli di immagine, come mani e testo o composizioni con informazioni spaziali (ad esempio, una donna sullo sfondo che insegue un cane in primo piano).

SDXL – spiega Stability AI – richiede solo poche parole per creare immagini complesse, dettagliate ed esteticamente gradevoli. Gli utenti non devono più ricorrere a termini qualificativi come “masterpiece” per ottenere immagini di alta qualità. Inoltre, SDXL è in grado di capire le differenze tra concetti come “The Red Square” (un luogo famoso) e “red square” (una forma).

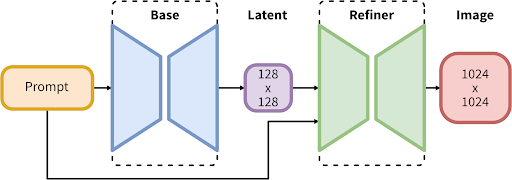

SDXL 1.0 è uno di quelli che ha più parametri, tra i modelli di immagini ad accesso libero: è costruito su una nuova architettura innovativa composta da un modello di base di 3,5 miliardi di parametri e da un refiner di 6,6 miliardi di parametri.

Il modello completo consiste in una pipeline mixture-of-experts per la latent diffusion: nella prima fase, il modello di base genera latent (rumorosi), che vengono poi elaborati con un modello di raffinamento specializzato per le fasi finali di denoising. Il modello di base può essere utilizzato anche come modulo indipendente.

Questa architettura a due stadi – spiega Stability AI – consente di ottenere una certa robustezza nella generazione delle immagini senza compromettere la velocità o richiedere un eccesso di risorse di calcolo. Il team afferma che SDXL 1.0 dovrebbe funzionare efficacemente su GPU consumer con 8 GB di VRAM o su istanze cloud facilmente disponibili.

Con SDXL 1.0 – sottolinea inoltre Stability AI –, la messa a punto del modello in base a dati personalizzati è più facile che mai. È possibile generare LoRA o checkpoint custom senza dover ricorrere al data wrangling. Il team di Stability AI sta realizzando la prossima generazione di controlli di struttura, stile e composizione task-specific, con T2I / ControlNet specializzati per SDXL. Queste funzioni sono attualmente in beta preview ma, annuncia l’azienda, il controllo delle immagini su SDXL è imminente.

Per iniziare a utilizzare SDXL 1.0 esistono diversi modi:

- SDXL 1.0 è disponibile su Clipdrop.

- I pesi di SDXL 1.0 e il codice sorgente associato sono stati rilasciati sulla pagina GitHub di Stability AI.

- SDXL 1.0 è stato rilasciato anche per le API sulla piattaforma Stability AI.

- SDXL 1.0 è disponibile su AWS Sagemaker e AWS Bedrock.

- Il Discord Stable Foundation è aperto per testare dal vivo i modelli SDXL.

- Anche DreamStudio ha SDXL 1.0 disponibile per la generazione di immagini.